Recent Posts

Link

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | ||||||

| 2 | 3 | 4 | 5 | 6 | 7 | 8 |

| 9 | 10 | 11 | 12 | 13 | 14 | 15 |

| 16 | 17 | 18 | 19 | 20 | 21 | 22 |

| 23 | 24 | 25 | 26 | 27 | 28 |

Tags

- tolerated

- pytest

- 깡돼후

- 코루틴 빌더

- 헥사고날아키텍처 #육각형아키텍처 #유스케이스

- 달인막창

- PytestPluginManager

- python

- mp4fpsmod

- VARCHAR (1)

- JanusWebRTCGateway

- 개성국밥

- terminal

- PersistenceContext

- table not found

- 자원부족

- preemption #

- vfr video

- taint

- Spring Batch

- 티스토리챌린지

- kotlin

- 코루틴 컨텍스트

- 오블완

- JanusWebRTCServer

- k8s #kubernetes #쿠버네티스

- 겨울 부산

- JanusWebRTC

- Value too long for column

- JanusGateway

Archives

너와 나의 스토리

[컴퓨터 공학] 용어 설명 및 최근 경향 - EPP/EDR/AI 본문

반응형

EPP (Endpoint Protection Platform)

- (예: 안티 바이러스, 데이터 암호화) 같이 endpoint 보호 기술을 모아 놓은 것

- endpoint에서 다양한 위협을 탐지하고 중지시킴

EDR (Endpoint Detection and Response)

- 사이버 위협을 지속적으로 모니터링하고 대응하여 사이버 위협을 완화하고 endpoint를 보호하는 사이버 기술

- EPP는 위협 탐지만 시키는데 이건 대응도 함.

- + CTI (Cyber Threat Intelligence)

- 사이버 위협에 대응할 수 있도록 도움을 주는 증거 기반의 지식

- 어떤 위협이나 공격이 발생하면 IP address, C&C server, IOC(Indicator Of Compromise, 침해지표) 등을 공유

- 이런 보안 정보를 공유해서, 공격에 대응할 때 사용

AI for Malware Detection

- 악성 코드 탐지보다는 발견된 악성코드 분류에 더 효과적

- 많이 쓰이지 않는 언어로 작성되거나 packing 되는 등 training data가 많지 않은 경우 새로운 악성 코드 탐지 어려움

- packing: 전체 악성 코드를 코드 내에 다 넣지 않고, 암호화를 시키거나 일부 기능만 binary로 들어있고, 어떤 서버에 접속해서 나머지 기능 실행시키는 형식

- 이런 경우, 전문가(사람)이 개입해서 찾는게 더 편함 (아직까지는...)

- 알려지지 않은 악성코드 및 anomaly detection

- Autoencoder 활용

- 정상 행위들을 작은 특징 벡터로 인코딩하고, 다시 이것들을 디코딩함

- unsupervised learning 가능

- Autoencoding: 이렇게 인코딩하는 것과 디코딩 하는 것이 합쳐진 것

- Autoencoder 활용

XAI (Explainable AI) for Security

- 단순히 yes or no를 출력하는 것이 아니라, 왜 그런 선택을 했는지 설명할 수 있는 기술

- 올바른 분류를 하더라도, 높은 metrics (accuracy, percision, recall) 만을 가지고 Deep Learning 모델을 믿을 수 있을까?

- Class Activation Model(CAM) 및 모델 신뢰도 이용

Security for AI

- Evasion Attack (Adversarial example)

- 이미 트레이닝한 데이터를 조금 바꿔서 넣어봄

- 안경 벗은 사진 트레이닝 시키고, 안경 쓴 사진 넣어봄

- Data poisoning

- 트레이닝 데이터를 이상한 것을 넣어 잘못 훈련되도록 공격

- AI model stealing

- Model inversion attack

- 모델에게 계속 쿼리를 날려 얻은 정보들로 내부를 분석함.

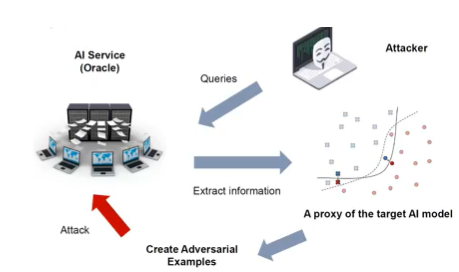

- AI model stealing + Adversarial example

- 공격자가 AI에게 계속 질문을 던져서 각 데이터들간의 경계선을 추측함. -> AI model stealing

- 그 경계선을 넘나들며 계속 공격 -> Adversarial example

반응형

'Computer Security' 카테고리의 다른 글

| Group, Finite Fields, Polynomial GCD, 다항식을 bit string으로 계산 (0) | 2020.10.23 |

|---|---|

| 페르마(Fermat), 오일러(Euler) 정리 / Primality test - Miller-Rabin Algorithm 설명 및 Python 코드 구현 (4) | 2020.10.23 |

| 역원 구하기 - Euclidean Algorithm / Extended Euclidean Algorithm (0) | 2020.10.22 |

| [컴퓨터 보안] 정수론 기초 - Divisibiliy, GCD, Congruences, Modular, 역원 (2) | 2020.10.22 |

| Web Hacking (0) | 2020.09.25 |

Comments